1 香味焙煎 ★ :2025/06/22(日) 06:58:00.20 ID:YpMtBwro9

実在する子どもの画像を、生成AIや画像加工アプリを悪用して、性的な画像に加工するなどした、いわゆる「性的ディープフェイク」は、世界的に大きな問題になっています。

国内でも「性的ディープフェイク」に関する相談や通報などが、全国の警察に相次いでいて、去年1年間に警察が把握した事案が100件以上にのぼったことが警察庁への取材でわかりました。

このうち、生成AIを悪用して作成されたものだと確認できた事案は少なくとも17件あり、15件は同級生などの知人によって作成されたものだったということです。

検挙に至った事案もあり、服を着ている同級生の女子生徒の画像を、生成AIで裸の画像に加工し、複数の同級生にSNSで拡散した男子中学生が名誉毀損の疑いで書類送検されたケースや、コンビニエンスストアで女子児童を盗撮し、生成AIで成人女性の裸の画像と合成した男の容疑者が、盗撮目的で建物に侵入したとして逮捕されたケースなどがあったということです。

また卒業アルバムの写真を悪用されたケースもあったということです。

警察庁は「警察への相談は一部に過ぎず、被害が潜在化している可能性がある。被害者に寄り添いつつ、法と証拠に基づいて対処する」としていて、青少年保護について話し合う有識者や関係省庁による作業チームで、悪用の実態について共有し、対策を検討することにしています。

NHK NEWS WEB

2025年6月22日 6時10分

https://www3.nhk.or.jp/news/html/20250622/k10014840991000.html

どれがと見分けつかないから2次元含めて全部規制でって流れかな

同級生*www同窓会とか行けないなヲイ

名誉毀損と建造物侵入だろ

それぐらい

同じこと思った。

個人ではPhotoshopなどの一般的な画像加工アプリでは簡単に作れないから

大半の人は生成できるものに頼ってしまう

既にphotoshopに生成AI搭載されてる

作ってやるからお前の写真だせ

あぁ、筋トレのイメージ画像が生成AIで作れる!

思い付かなかったな、すごく効率良さそうな気がするから試してみよう。

いい加減フェミの言いなりになるのやめろって

実在する人物の裸画像は駄目だろ

拡散してるからじゃないか?

コラ画像ってのが昔からあるが、あれも拡散してりゃアウトだが、そうでなけりゃ事件にもならんのだし。

ひっそりシコるってのができないバカがわんさかいるから問題なんだろ

自己承認欲求世代だから我慢できないんだろうな

何事もそうだな、違法なサイトとかも言わなきゃいいのに拡散して規制までの流れいっぱいあるし

あれは逮捕されると思うけどな・・・

そうした拡散するアホが逮捕なり事件になるだけで、作る分ではどうにもならん。

そんなことしないよ

警察は犯罪の撲滅なんて望んでないのはわかるだろ?

何故じゃ

今までは技術が必要

そういう技術を持つ人はあまりアホなことはしない

AIで、アホでも使えるようになった

詐欺メールの文面だって考えてもらえる

フェイクって直ぐバレるからだがAIのはすげーわかりにくいし

男なら堂々と*よ

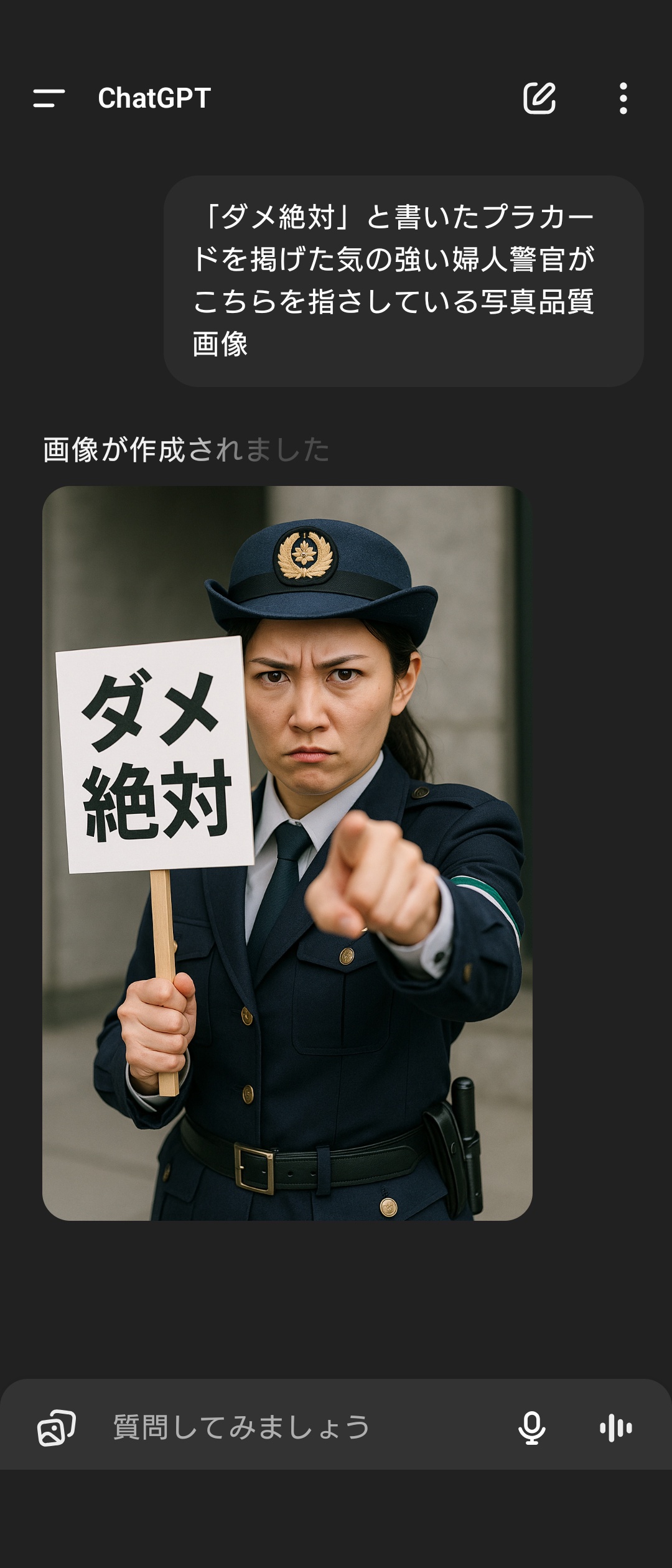

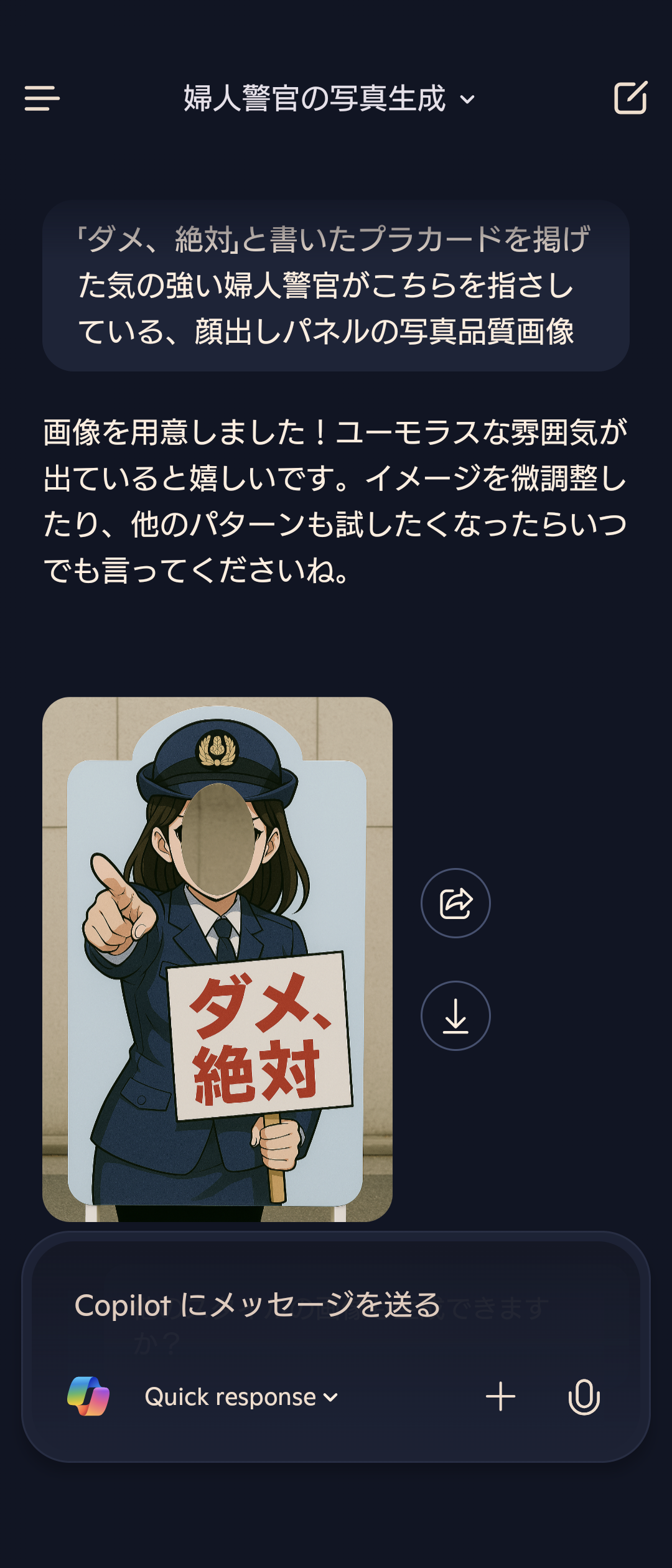

ちょっとしたことでこの画像はブロックされましたと出て作れない

AIに奪われない仕事。アイコラ職人

貼ってあった

翌日、言いふらしてやった

お前は本物のクズだな

反省もしてないようだ

こういう奴ホント最後は苦しみ抜いて*でほしい

アイドルなら言いふらしても

大したことにならんけど

同級生の顔写真とかだと大惨事

(出典 i.imgur.com)

リビングルームおじさんじゃんw

後ろの写真不気味で草

子供部屋にソファーとかやるじゃん

絵は画風があってしんどいかもしれんがゲームキャラの裸MOD作ってる奴は確実に捕まえれるだろうな

元のゲームを使ったデータだから

自分が好きなゲームのキャラがそういう目にあうの見てて気分がいいわけない

罰金100億でw

37のおばさんだろうに